Una publicación de Instagram asegura que Anthropic, la empresa detrás de Claude AI, pidió ayuda al Vaticano porque su inteligencia artificial “iba demasiado rápido para que pudieran controlarla”.

La afirmación es engañosa. Aunque existió acercamiento con un sacerdote católico ligado a una iniciativa entre la Universidad de Santa Clara y el Vaticano, y también hubo una reunión con líderes cristianos para discutir cuestiones morales sobre la IA, no hay evidencia de que Anthropic haya buscado esa ayuda por una falla técnica o porque su sistema se hubiera salido de control.

Lo documentado apunta a una consulta ética y filosófica sobre el desarrollo de modelos de IA, no a una emergencia tecnológica.

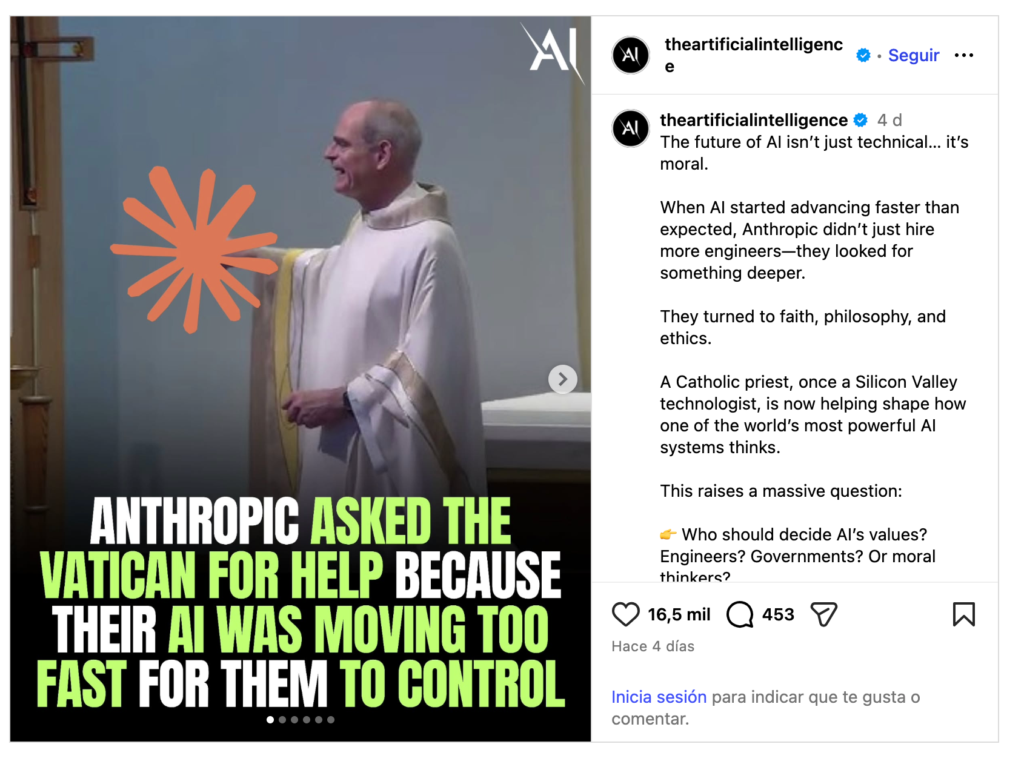

- Qué verificamos: Una publicación de Instagram que afirma que Anthropic pidió ayuda al Vaticano porque su IA avanzaba demasiado rápido y no podían controlarla.

- Lo que afirma: Que Anthropic acudió al Vaticano por miedo a que su inteligencia artificial se les fuera de control.

- Nuestra conclusión: ENGAÑOSO.

- A quién involucra: Anthropic, Claude AI, el padre Brendan McGuire, la Universidad de Santa Clara y figuras vinculadas al Vaticano.

¿Qué se dijo o qué circula?

En Instagram circula una publicación de la cuenta theartificialintelligence con el mensaje en inglés: “Anthropic asked the Vatican for help because their AI was moving too fast for them to control” (“Anthropic pidió ayuda al Vaticano porque su IA avanzaba demasiado rápido para que pudieran controlarla”).

El contenido acompaña esa frase con la imagen de un sacerdote y sugiere que la empresa tecnológica recurrió a la Iglesia católica porque había perdido la capacidad de controlar su sistema.

La publicación parte de hechos reales, pero los reorganiza bajo un enfoque alarmista.

Aunque, existió colaboración entre Anthropic y actores religiosos, y también hay registro de un trabajo conjunto con el sacerdote Brendan McGuire y otros especialistas sobre la dimensión ética de la inteligencia artificial. Sin embargo, no existe evidencia de que esa colaboración se debiera a una pérdida de control técnico del sistema.

¿Qué dicen los datos oficiales y fuentes confiables?

Mediante una búsqueda manual en Google, se identificaron varios reportes de prensa que señalan que un sacerdote católico con trayectoria tecnológica colaboró con Anthropic.

Por ejemplo, el medio Observer informó que el padre Brendan McGuire ayudó, junto con otros líderes religiosos, a dar forma a la “Constitución” de Claude, es decir, al conjunto de principios que orienta el comportamiento del modelo.

Ese mismo reportaje lo describe como sacerdote, exejecutivo tecnológico y participante en debates sobre ética aplicada a la inteligencia artificial.

Además, se reportó un vínculo con estructuras relacionadas con el Vaticano. La Universidad de Santa Clara informa oficialmente que el Institute for Technology, Ethics, and Culture (ITEC) es una colaboración entre su Markkula Center for Applied Ethics y el Dicasterio para la Cultura y la Educación del Vaticano. McGuire figura públicamente asociado a ese ecosistema de trabajo enfocado en la ética tecnológica.

Observer también recogió una declaración de McGuire en la que afirmó que los fundadores de Anthropic buscaban “ayuda directa del Vaticano” para convocar y orientar a la industria, en un contexto en el que el sector avanzaba con rapidez.

Sin embargo, esa frase no describe una falla en el control de Claude, sino la velocidad del desarrollo de la industria y la necesidad de orientación ética.

A ello se suma un segundo hecho comprobado: The Washington Post reportó que Anthropic organizó, a finales de marzo de 2026, una cumbre de dos días en San Francisco con cerca de 15 líderes cristianos de ámbitos religiosos, académicos y empresariales.

Según ese medio, la empresa buscó asesoramiento sobre cómo orientar el desarrollo moral y espiritual de Claude frente a preguntas éticas complejas, incluido cómo responder a usuarios en duelo.

La propia Anthropic explica oficialmente que, en Claude, esta colaboración se articula mediante una “constitución”, es decir, un documento que expresa los valores y comportamientos que la empresa busca que el modelo encarne.

Anthropic señala que ese texto es una parte central del entrenamiento del sistema y que su objetivo es hacerlo más seguro, ético y alineado con sus principios. Esto refuerza que el debate giraba en torno a la alineación y los valores, no a un descontrol técnico.

¿Hay elementos manipulados u omitidos?

Sí. El principal elemento engañoso es la frase “because their AI was moving too fast for them to control” (porque su IA avanzaba demasiado rápido para que pudieran controlarla).

Esa formulación sugiere que Claude estaba fuera de control o que Anthropic enfrentaba una crisis técnica inminente. Ninguna de las fuentes revisadas sostiene eso.

Lo documentado muestra otra cosa: Anthropic recurrió a líderes religiosos y expertos en ética para discutir cómo debería comportarse una IA frente a dilemas morales complejos. Es decir, una consulta deliberada sobre valores, límites y dignidad humana.

De hecho, la propia documentación oficial de Anthropic sobre la “Constitución” de Claude habla de un marco para moldear el comportamiento del modelo, mientras que la información de Santa Clara y del Vaticano sitúa estas conversaciones en el terreno de la ética y la cultura, no en una situación de emergencia tecnológica.

En otras palabras, el post toma una noticia real y la exagera con una narrativa sensacionalista. Cambia una consulta ética por una supuesta pérdida de control.

¿Se puede comprobar la trazabilidad del contenido?

Sí, parcialmente. La trazabilidad del núcleo real de la historia sí puede comprobarse.

Por un lado, hay rastro público de la participación de Brendan McGuire en discusiones éticas sobre IA y su relación con ITEC, organismo vinculado a Santa Clara y al Dicasterio del Vaticano.

Por otro, hay trazabilidad periodística de la cumbre organizada por Anthropic con líderes cristianos en marzo de 2026, según The Washington Post.

Y también existe trazabilidad oficial del concepto de “Constitución” de Claude en materiales publicados por Anthropic.

Lo que no se puede comprobar en ninguna fuente fiable es que Anthropic haya buscado ayuda porque “no podía controlar” su IA. Esa parte del mensaje no aparece sustentada por documentos oficiales ni por los reportes consultados.

Nuestra conclusión

La publicación es engañosa. Se basa en hechos reales, pero los presenta de forma distorsionada.

Sí hubo acercamiento entre Anthropic y figuras religiosas, incluido el padre Brendan McGuire, y también existieron conversaciones con personas vinculadas al Vaticano y con líderes cristianos sobre la dimensión moral de la inteligencia artificial.

Sin embargo, no hay evidencia de que la empresa buscara ayuda porque Claude se hubiera salido de control o porque su IA avanzara de una manera técnicamente incontrolable.

Las fuentes revisadas muestran una consulta ética y filosófica sobre cómo orientar los valores del sistema, no una reacción de pánico ante una falla.

El riesgo de este tipo de publicaciones es que convierten un debate serio sobre gobernanza y ética de la inteligencia artificial en una narrativa alarmista propia de la ciencia ficción.

Contexto adicional

El caso ocurre en un contexto más amplio en el que tanto empresas tecnológicas como instituciones religiosas vienen discutiendo el impacto de la inteligencia artificial sobre la dignidad humana, la autonomía, la responsabilidad y la toma de decisiones morales.

Anthropic lleva años desarrollando el enfoque de “Constitutional AI”, una metodología en la que los modelos se entrenan usando principios normativos explícitos. La empresa ha publicado tanto investigaciones como documentos institucionales sobre ese enfoque, y en enero de 2026 difundió una nueva versión de la constitución de Claude.

Del lado de la Iglesia católica, el Vaticano también ha intensificado su reflexión sobre IA. En 2025 publicó la nota Antiqua et nova, en la que plantea que el desarrollo y uso de la inteligencia artificial debe respetar la dignidad humana y promover el bien común.

Por eso, que existan puentes entre empresas de IA, universidades y entidades religiosas no es en sí una anomalía ni una señal de colapso tecnológico.

Lo que muestran estos hechos es una búsqueda de marcos éticos ante sistemas cada vez más influyentes.

El contenido engañoso aparece cuando esa discusión se transforma en un relato de “IA fuera de control” sin respaldo verificable.

Fuentes:

- Observer, The Catholic Priest Who Helped Write Anthropic’s A.I. Ethics Code.

- The Washington Post, Can AI be a ‘child of God’? Inside Anthropic’s meeting with Christian leaders.

- Anthropic, Claude’s new constitution.

- Anthropic, página oficial de Claude’s Constitution.

- Anthropic, Collective Constitutional AI.

- Santa Clara University, Institute for Technology, Ethics, and Culture (ITEC).

- Vaticano, Antiqua et nova: Nota sobre la relación entre la inteligencia artificial y la inteligencia humana.

- National Catholic Reporter, perfil de Brendan McGuire.