Un video difundido en redes asegura que una fotografía relacionada con el caso del presunto narcotraficante Jezdimir Srdan fue alterada con inteligencia artificial para influir en la opinión pública.

Ecuador Chequea sometió la imagen a herramientas especializadas, consultó a medios y revisó documentos oficiales.

No existe evidencia concluyente que permita afirmar con certeza que la imagen haya sido manipulada con IA.

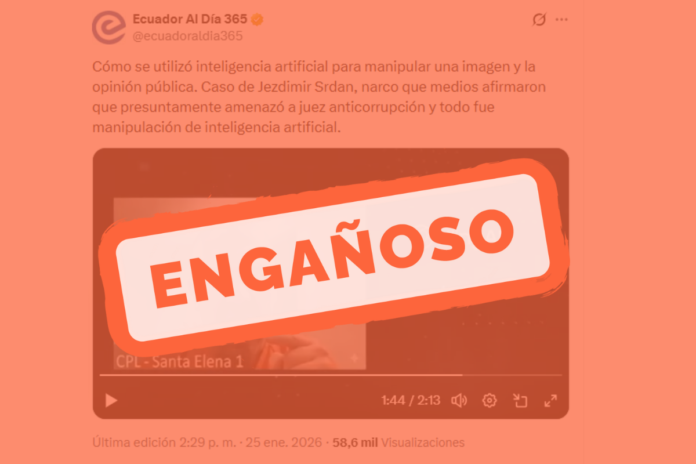

Qué verificamos: Una publicación en redes sociales que asegura que una fotografía del caso Jezdimir Srdan fue manipulada con inteligencia artificial.

Lo que afirma: Que la imagen fue generada o alterada con IA como parte de una estrategia de manipulación de la opinión pública.

Nuestra conclusión: ENGAÑOSO

A quién involucra: Usuarios en redes sociales, medios de comunicación que difundieron la imagen y el sistema judicial.

Qué se dijo o qué circula

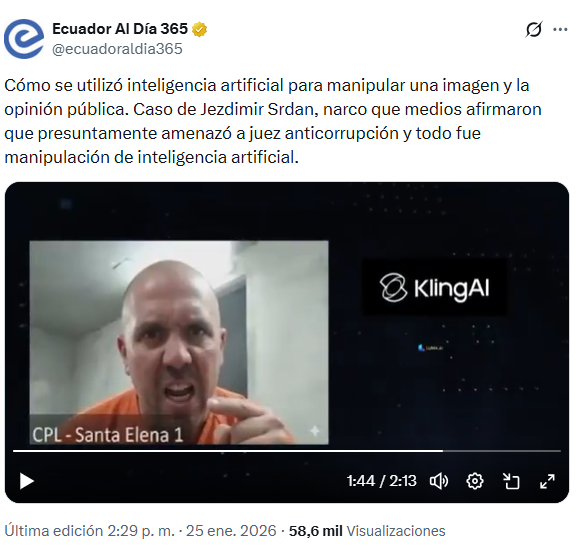

En redes sociales circula un video que asegura, que una imagen difundida por medios ecuatorianos sobre la audiencia que trataba el caso del presunto narcotraficante Jezdimir Srdan fue manipulada con inteligencia artificial.

El contenido afirma que la fotografía habría sido generada o alterada para influir en la percepción pública del caso y desacreditar a actores judiciales involucrados.

El mensaje se presenta como una revelación técnica, con lenguaje de certeza, sin mostrar documentos oficiales ni fuentes independientes que confirmen la supuesta manipulación.

El contenido se difundió principalmente en plataformas digitales y cuentas alineadas con una narrativa política específica, donde se presenta como prueba de una supuesta operación mediática.

Ecuador Chequea identificó que la publicación fue compartida en redes sociales de alta circulación, con énfasis en discursos que cuestionan la legitimidad de procesos judiciales y mediáticos.

Qué dicen las fuentes confiables

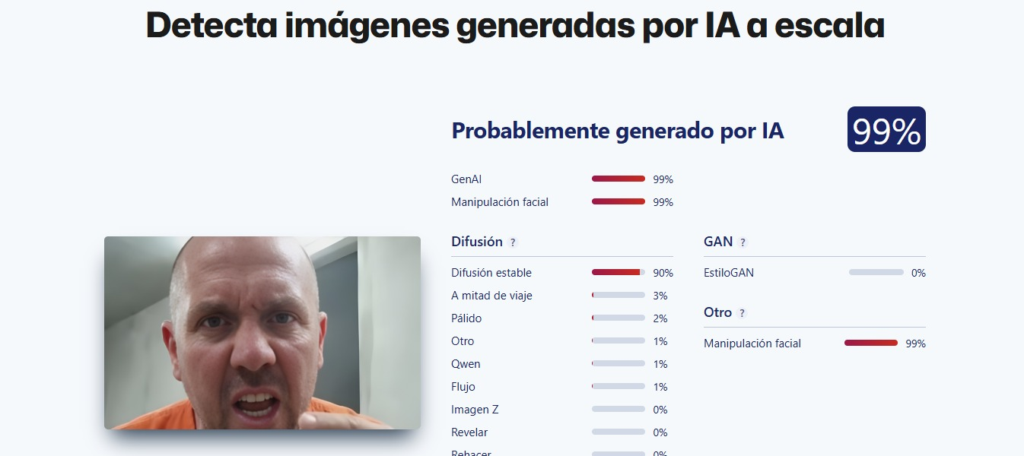

Ecuador Chequea sometió la imagen a cuatro herramientas de detección de contenido generado por IA:

• Hive Moderation: 0% de probabilidad de uso de IA.

- Isgen.ai: La puntió como 100% humano y arrojó el mensaje: es probable que este medio sea original y no generado por IA”.

• Undetectable: la calificó con el 98% de manipulación.

• Sightengine: 99% de probabilidad de generación o alteración con IA.

La disparidad de resultados demuestra que no existe consenso técnico que permita afirmar con certeza que la imagen haya sido manipulada.

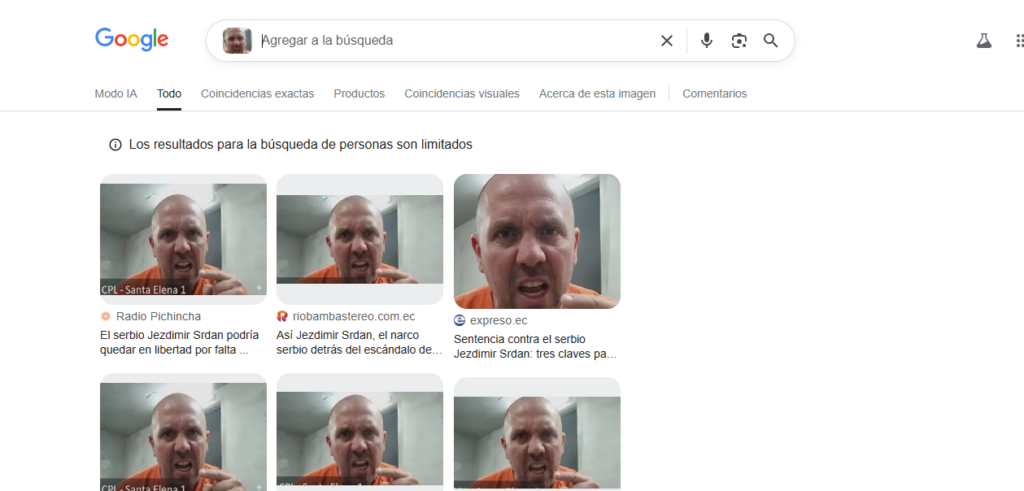

Además, Ecuador Chequea realizó una búsqueda inversa con Google Imágenes y constató que la fotografía fue publicada por varios medios de comunicación.

Ecuador Chequea, pudo conversar con dos medios de comunicación, quienes aseguraron que las fotos de sus portadas, fueron obtenidas a partir de un parte policial. Sin embargo, al revisar ese documento que contiene cinco fotografías, de la audiencia, pero, en las cinco no se encuentran la imagen que colocó el contenido a verificar.

¿Hay elementos manipulados u omitidos?

Sí. El vídeo viral omite un elemento clave, pues, no aclara que las herramientas de detección de IA no son infalibles y que sus resultados deben interpretarse como probabilísticos, no como pruebas definitivas.

Presentar un solo resultado como “certeza técnica” distorsiona la realidad del proceso de verificación digital y convierte una hipótesis en una afirmación categórica.

Además, al verificar la imagen en la misma plataforma donde circula el post, se identificó que esta aparece asociada a Gemini, lo que sugiere que fue creada o editada mediante herramientas de inteligencia artificial de Google.

En cambio, la imagen utilizada durante la transmisión televisiva y posteriormente publicada en los portales de medios de comunicación no presenta el logo ni la identificación de Gemini.

¿Se puede probar la trazabilidad?

Parcialmente.

• Se puede rastrear la circulación mediática de la imagen.

• Se puede verificar que no figura en el parte policial revisado.

• Pero no se puede probar técnicamente que la imagen haya sido creada o manipulada con IA, ni tampoco que sea auténtica.

La trazabilidad es incompleta y, por tanto, no permite sostener una conclusión cerrada.

Nuestra conclusión

La afirmación de que la imagen fue manipulada con inteligencia artificial es ENGAÑOSA porque:

• No existe evidencia técnica concluyente.

• Las herramientas arrojan resultados contradictorios.

• Se presenta como certeza lo que, en el mejor de los casos, es una hipótesis.

• Se omite deliberadamente la incertidumbre metodológica.

La narrativa no se apoya en pruebas verificables, sino en una interpretación política de datos técnicos incompletos.

Contexto adicional

Este caso ilustra un fenómeno cada vez más frecuente: lla instrumentalización de la inteligencia artificial como argumento de autoridad discursiva.

No se busca explicar cómo funciona la IA, sino usarla como recurso retórico para:

• desacreditar contenidos,

• erosionar la confianza en medios,

• y disputar la legitimidad de procesos institucionales.

En este contexto, el problema no es la tecnología, sino el uso político de la certeza simulada como forma de desinformación.

Fuentes utilizadas

• Herramientas de detección: Hive Moderation, Sightengine.

• Búsqueda inversa: Google Imágenes. • Documento oficial: Parte policial del caso Jezdimir Srdan