Con cada vez más facilidad se pueden realizar ‘deepfakes’ de cualquier persona y usarlos para estafas o para manipular a la opinión pública. ¿La solución? Desarrollar una actitud cada vez más crítica, dudar y verificar antes de creer o compartir.

POR: Juan Camilo Escobar

“Cada día es más difícil reconocer cuál es la diferencia entre el video real y el deepfake. Creo que debemos desarrollar herramientas para discernir cuando es real y no. Hasta ahora no me ha afectado en lo personal, pero sí me han llamado la atención las ‘noticias falsas’ de la política”, comenta Jair Campaña.

No es comentario cualquiera. Es el testimonio de un técnico y docente de la Facultad de Comunicación Social de la Universidad Central, en Quito, con un ojo entrenado en las más recientes tecnologías audiovisuales.

Para quienes no son especialistas en la materia, se trata de una verdadera advertencia sobre el impacto de este tipo de videos cada vez más realistas creados con inteligencia artificial.

Dos expertos consultados por Ecuador Chequea respondieron que, hasta el momento, no se ha desarrollado una herramienta definitiva que permita detectarlos. Por tanto, es indispensable aplicar el sentido común y una actitud crítica, en especial si los contenidos son excesivamente llamativos o inusuales

Así, Pamela Jaramillo, especialista de la firma internacional de ciberseguridad Eset, recomendó que lo primero es “fijarse en los parpadeos, en el movimiento de los labios y en las sombras. Pero, además, siempre procurar validar el contenido por otros medios”.

El consultor digital Christian Espinosa Moreano, también dijo que “hay señales, gestos que no coinciden con el audio, sombras o reflejos extraños o bordes difusos. La clave es simple: verifica dos veces antes de compartir”.

Lo sorprendente de este último consejo práctico, es que Espinosa Moreano lo dio a través de un clon de sí mismo…. ¡Creado con inteligencia artificial!

Así, por más que se mire varias veces, costará distinguir si es o no real. El titilar de la luz de neón, casi imperceptible, es, quizás, la única pista o indicio de que fue creado por inteligencia artificial. tal como puede apreciar en este video:

Y de la facilidad de crear estos contenidos da cuenta Jaramillo, quien aseguró que se pueden hacer con facilidad, en poco tiempo, con solo tres minutos de videos publicados en redes sociales de cualquier persona.

¿Y si no es una persona cualquiera, sino un personaje conocido, periodista, autoridad o político? En el caso de Ecuador, Ecuador Chequea verificó en abril cómo ciberdelincuentes crean deepfakes de periodistas como Mónica Almeida, presentadores de noticieros de televisión y figuras públicas como Jefferson Pérez o Isabel Noboa para falsas campañas en redes sociales de supuestas plataformas financieras. En una de ellas, por ejemplo, se pide a la gente que invierta 90 mil dólares para “obtener ganancias superiores a los $900 mil semanales”. Así, los expertos consultados confirmaron que detrás de estos contenidos falsos se encuentra una “maquinaria digital cuidadosamente diseñada para simular legitimidad, generar confianza y persuadir emocionalmente a sus víctimas”.

En lo político, en las elecciones presidenciales de abril, aparecieron en este tipo de videos falsos de personajes reales difundiendo mentiras. Por ejemplo, la entonces candidata presidencial, Luisa González, aseverando que aplicará en Ecuador un régimen como el de Venezuela; o el de un presentador del canal de televisión de Alemania, Deutsche Welle, calificando de corrupto al entonces candidato presidencial Daniel Noboa.

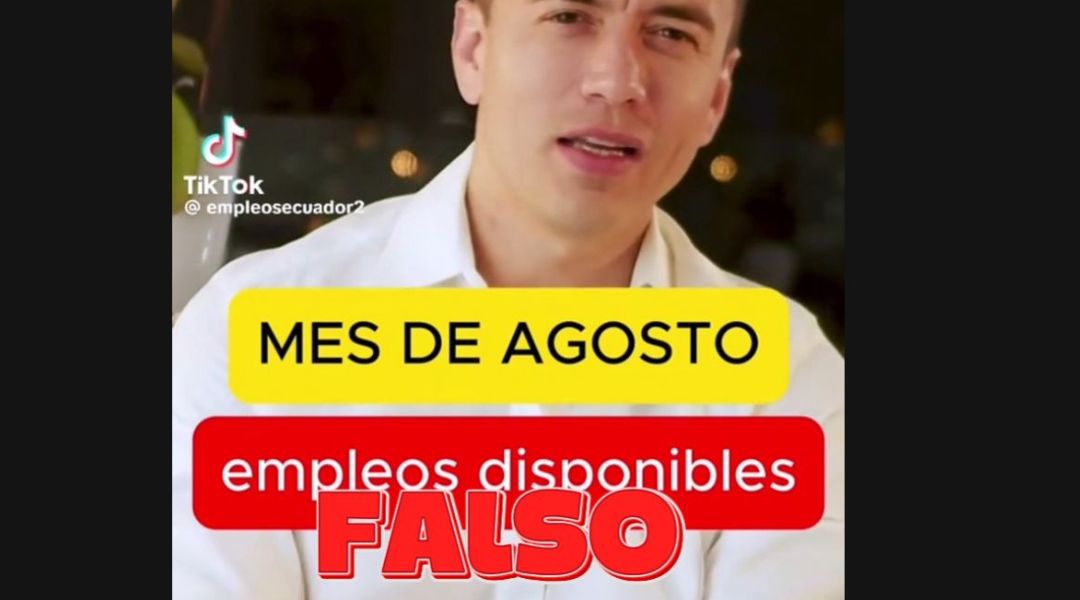

Y en días recientes, el presidente, Daniel Noboa, aparece en un falso anuncio de una plataforma de empleos que pide a la gente ingresar a un enlace malicioso. Lo curioso es que, pese a que el contenido ya fue reportado como falso, Facebook aún no lo elimina.

¿Soluciones? Consultado sobre el tema el intendente de innovación tecnológica y de seguridad de datos de la Superintendente de Datos, Luis Enríquez, comentó que se trata de uno de los problemas de seguridad más graves que en los actuales tiempos enfrenta la humanidad, frente al cual Ecuador aún no está preparado.

El país, dijo, “aún está en pañales” para que la gente asuma una cultura con actitudes más críticas, no solo frente a los contenidos digitales que consume, sino también frente los datos que entrega indiscriminadamente, sin verificar, que sean tratados y protegidos, y que eventualmente corren el riesgo de que sirvan para que se suplante su identidad mediante los deepfakes u otras formas de estafas digitales.

Esto último sucede, por ejemplo, cuando la gente se deja tomar una foto de su cédula o se deja escanear el rostro para ingresar a ciertos conjuntos residenciales o edificios.

Por ahora, hay alternativas que están planteando algunos países nórdicos, como Dinamarca, mediante un proyecto de ley para declarar como propiedad intelectual y de autor de una persona cualquier réplica o clon de su imagen personal, incluidos los videos generados con inteligencia artificial.

“Es un problema gravísimo y, si no lo abordamos, vamos a seguir sufriendo sus efectos de una manera exponencial. Con una ley en Dinamarca para que todos los clones digitales sean de propiedad intelectual y derechos de autor de una persona, ya hay visión jurídica de cómo proteger”, comentó el experto.

Recalcó la gravedad y la urgencia que enfrenta el país para enfrentar este problema, tanto en lo cultural como en lo legal porque, a su criterio, “se puede cambiar la contraseña, pero no se puede cambiar la cara”. Lo dijo luego de señalar que cada vez existen herramientas más sofisticadas, que permiten crear un deepfake en cuestión de minutos, incluso sin datos biométricos, sino con una simple foto.

En respuesta a una consulta de Ecuador Chequea, sobre los impactos de los deepfakes detectados en los países de América Latina donde opera, Eset puntualizó cuatro:

- Desinformación y manipulación de la opinión pública: pueden ser utilizados para difundir información falsa, lo que puede tener un impacto en la percepción de la opinión pública.

- Violación de la privacidad: utilizan datos personales sensibles, como la imagen del rostro y la voz, sin contar con el permiso de sus titulares, trasgrediendo la privacidad y ocasionando un robo de identidad.

- Pérdidas económicas: pueden ser utilizados para cometer fraudes financieros, lo que puede resultar en grandes pérdidas económicas.

- Daño a la reputación: pueden ser utilizados para dañar la reputación de individuos y organizaciones.

Así, las advertencias de que 2023 era el último año que una foto real se podría distinguir a simple vista quedaron cortas. Hoy, mientras las herramientas tecnológicas se perfeccionan, sólo nos queda el sentido común y actitud crítica.

Te puede interesar:

. Es falso: ninguna ley establece 5 años de cárcel por salir a protestar

. Estado busca ayuda para frenar reclutamiento criminal de menores

. Organizaciones sociales buscan unificar estrategias frente al Gobierno